MINING CLOUD BIG DATA

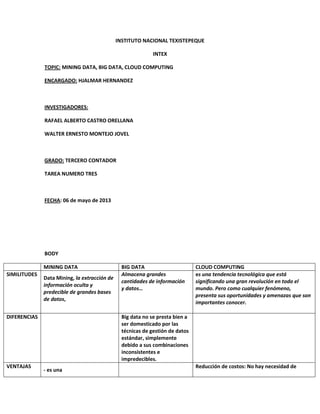

- 1. INSTITUTO NACIONAL TEXISTEPEQUE INTEX TOPIC: MINING DATA, BIG DATA, CLOUD COMPUTING ENCARGADO: HJALMAR HERNANDEZ INVESTIGADORES: RAFAEL ALBERTO CASTRO ORELLANA WALTER ERNESTO MONTEJO JOVEL GRADO: TERCERO CONTADOR TAREA NUMERO TRES FECHA: 06 de mayo de 2013 BODY MINING DATA BIG DATA CLOUD COMPUTING SIMILITUDES Data Mining, la extracción de información oculta y predecible de grandes bases de datos, Almacena grandes cantidades de información y datos… es una tendencia tecnológica que está significando una gran revolución en todo el mundo. Pero como cualquier fenómeno, presenta sus oportunidades y amenazas que son importantes conocer. DIFERENCIAS Big data no se presta bien a ser domesticado por las técnicas de gestión de datos estándar, simplemente debido a sus combinaciones inconsistentes e impredecibles. VENTAJAS - es una o Reducción de costos: No hay necesidad de

- 2. Poderosa tecnología nueva con gran potencial para ayudar a las compañías a concentrarse en la información más importante de sus Bases de Información -Las herramientas de Data Mining predicen futuras tendencias y comportamientos, permitiendo en los negocios tomar decisiones proactivas. - pueden analizar bases de datos masivas para brindar respuesta a preguntas tales como, "¿Cuáles clientes tienen más probabilidad de responder al próximo mailing promocional, y por qué? - presentar los resultados en formas de tablas, con gráficos, reportes, texto, hipertexto, etc -está soportado por tres tecnologías que ya están suficientemente maduras: Recolección masiva de datos Potentes computadoras con multiprocesadores Algoritmos de Data Mining BRINDA CAPACIDADES COMO: Predicción automatizada de tendencias y comportamientos. Data Mining automatiza el proceso de encontrar información predecible en grandes bases de datos. Preguntas que tradicionalmente requerían un intenso análisis manual, -Es una referencia a los sistemas que manipulan grandes conjuntos. -aplicado a conjuntos de datos que superan la capacidad del software habitual para ser capturados, gestionados y procesados en un tiempo razonable. -Los tamaños del "big data" se encuentran constantemente en movimiento creciente. -el crecimiento constante de datos como una oportunidad y reto para investigar en el volumen, la velocidad y la variedad. Gartner continúa usando big data como referencia de este. -Las máquinas modernas, tales como automóviles, trenes, centrales eléctricas y aviones todos se aumenta el número de sensores de recolección constantemente grandes cantidades de datos. Es común hablar de tener miles o incluso cientos de miles de sensores de todo recogiendo información sobre el funcionamiento y las actividades de una máquina. adquirir hardware y software lo que reduce costos operativos en infraestructura, mantenimiento y energía. La nube es más barata que la instalación y mantenimiento de un servidor propio o contratar los servicios de un proveedor. o Flexibilidad: El servicio de nube se paga de acuerdo a la demanda. Si, por ejemplo, una empresa los días treinta incrementa el movimiento de su área contable y financiera por pagos a empleados y proveedores, puede decidir que requiere mayor capacidad de proceso o de almacenamiento de datos, y pagará por una mayor demanda, pero sólo el día 30. o Movilidad: Los datos de una empresa al quedar alojados en la nube pueden ser consultados por los empleados desde cualquier lugar. Esta característica está significando un crecimiento del teletrabajo con todos sus efectos de tipo económico, social e incluso, inmobiliario. o Focalización: Cloud Computing permite a las compañías centrarse en su corebusiness, negocio principal. En vez de hacer una alta inversión tecnológica en sistemas, una empresa podría invertir en su infraestructura industrial o física o en capital humano para proseguir sus planes de expansión o Ecología: Usar la nube en una empresa reduce la huella de carbono de una empresa al ahorrar recursos y componentes que pasan de estar almacenados en componentes físicos a ser virtuales. Se ahorra también en consumo de energía con sus beneficios al medio ambiente.

- 3. ahora pueden ser contestadas directa y rápidamente desde los datos. Descubrimiento automatizado de modelos previamente desconocidos. Otros problemas de descubrimiento de modelos incluye detectar transacciones fraudulentas de tarjetas de créditos e identificar datos anormales que pueden representar errores de tipeado en la carga de datos. Las bases de datos pueden ser grandes tanto en profundidad como en ancho: Más columnasUn Data Mining de alto rendimiento permite a los usuarios explorar toda la base de datos, sin preseleccionar un subconjunto de variables. Más filas. Muestras mayores producen menos errores de estimación y desvíos, y permite a los usuarios hacer inferencias acerca de pequeños pero importantes segmentos de población. , detección de fraudes, lanzamiento de nuevos productos, etc. -Los datos enviados desde cientos de miles de sensores en un avión es de grandes volúmenes de datos. Sin embargo, el tamaño del conjunto de datos no es tan grande como podría esperarse. Hasta cien mil sensores, cada una produciendo un byte de ocho leer cada segundo se producen menos de 3 GB de datos en una hora de vuelo (100.000 sensores x 60 minutos x 60 segundos x 8 bytes). -Hay un número creciente de sistemas que generan grandes cantidades de datos muy simples. Por ejemplo, los medios de transmisión es la generación de grandes volúmenes con cantidades crecientes de metadatos estructurados. Del mismo modo, las empresas de telecomunicaciones tienen que rastrear grandes volúmenes de llamadas y conexiones a Internet. Incluso si estas dos actividades se combinan, y peta bytes de datos se produce, el contenido es muy estructurado. Como los motores de búsqueda, como Google y bases de datos relacionales han demostrado, los conjuntos de datos se pueden analizar muy rápidamente si el contenido está bien estructurado. A pesar de que estos datos son grandes, no es "grande" en la misma forma que los

- 4. datos procedentes de los sensores de la máquina en el ejemplo anterior. DESVENTAJA S Las dificultades más habituales en estos casos se centran en la captura, el almacenado,búsqueda, compartición, análisis, y visualización. El tamaño es una característica de los grandes volúmenes de datos. La respuesta está en el número de fuentes de datos independientes, cada uno con el potencial de interactuar. Otro atributo de los grandes volúmenes de datos es su tendencia a ser difícil de eliminar lo que la privacidad de un interés común. Por ejemplo, es casi imposible para purgar todos los datos asociados con un conductor de coche de individuo a partir de datos de autopistas de peaje. Los captadores de recuento del número de automóviles ya no equilibrar con los registros de facturación individuales que, a su vez, no se correspondería con los pagos recibidos por la empresa. La centralización de las aplicaciones y el almacenamiento de los datos origina una interdependencia de los proveedores de servicios. La disponibilidad de las aplicaciones está ligada a la disponibilidad de acceso a Internet. Los datos "sensibles" del negocio no residen en las instalaciones de las empresas, lo que podría generar un contexto de alta vulnerabilidad para la sustracción o robo de información. La confiabilidad de los servicios depende de la "salud" tecnológica y financiera de los proveedores de servicios en nube. Empresas emergentes o alianzas entre empresas podrían crear un ambiente propicio para el monopolio y el crecimiento exagerado en los servicios.4 La disponibilidad de servicios altamente especializados podría tardar meses o incluso años para que sean factibles de ser desplegados en la red. La madurez funcional de las aplicaciones hace que continuamente estén modificando sus interfaces, por lo cual la curva de aprendizaje en empresas de orientación no tecnológica tenga unas pendientes significativas, así como su consumo automático por aplicaciones. Seguridad. La información de la empresa debe recorrer diferentes nodos para llegar a su destino, cada uno de ellos (y sus canales) son un foco de inseguridad. Si se utilizan protocolos seguros, HTTPS por ejemplo, la

- 5. velocidad total disminuye debido a la sobrecarga que éstos requieren. Escalabilidad a largo plazo. A medida que más usuarios empiecen a compartir la infraestructura de la nube, la sobrecarga en los servidores de los proveedores aumentará, si la empresa no posee un esquema de crecimiento óptimo puede llevar a degradaciones en el servicio o altos niveles de jitter.